V statistiki in teoriji verjetnosti korelacija pomeni, kako tesno sta povezana dva niza podatkov. Korelacija meri usmerjenost in jakost zveze med spremenljivkama, vendar sama po sebi še ne pove nič o vzročnosti.

Definicija in osnovne lastnosti

Korelacija opisuje, ali se spremembe v eni spremenljivki ujemajo s spremembami v drugi spremenljivki in v katero smer. Glavne lastnosti korelacijskega koeficienta (npr. Pearsonovega r) so:

- vrednost je običajno med -1 in +1;

- +1 pomeni popolno pozitivno linearno zvezo (oba naraščata skupaj);

- -1 pomeni popolno negativno linearno zvezo (ena narašča, druga pada);

- 0 pomeni, da ni linearne zveze — lahko pa obstaja ne-linerna zveza.

Smeri in moč korelacije

Smer korelacije je določena s predznakom koeficienta (+ ali -). Moč korelacije opisuje, kako tesna je zveza: majhna, zmerna ali močna. Pogoste omejne smernice za Pearsonov r (Cohenove smernice) so približno:

- |r| ≈ 0.1: majhen učinek;

- |r| ≈ 0.3: zmeren;

- |r| ≥ 0.5: velik (močan) učinek.

Te meje so zgolj smernice — njihovo smiselnost je odvisna od konteksta in raziskovalnega področja.

Merila povezanosti (pogosti koeficienti)

Za različne vrste podatkov in razmer se uporabljajo različna merila:

- Pearsonov korelacijski koeficient (r) — meri linearno zvezo med dvema količinskima (intervalnima/razmerjnimi) spremenljivkama. Primer izračuna: r = Σ(xi - x̄)(yi - ȳ) / sqrt[Σ(xi - x̄)² Σ(yi - ȳ)²]. Predpostavlja linearnost, normalnost in občutljiv je na odmaknjene vrednosti (outlierje).

- Spearmanov rang koeficient (ρ) — neparametrično merilo, ki temelji na rangih. Uporaben za monotone (ne nujno linearne) povezave ali kadar podatki niso normalno porazdeljeni.

- Kendallov tau — še eno rangovno merilo, robustno in uporabno pri majhnih vzorcih ali številnih vezanih rangih.

- Phi koeficient — za dve binarni (dvočleni) spremenljivki.

- Cramér's V — za nominalne spremenljivke z več kot dvema kategorijama (na primer križna tabela).

- Point-biserial — za povezavo med eno binarno in eno količinsko spremenljivko.

- Polychorični/Polyserial koeficienti — za predpostavko latentne neprekinjene spremenljivke, ki se meri z ordinalnimi kategorijami.

- Delna korelacija — meri zvezo med dvema spremenljivkama ob kontroliranju učinka ene ali več drugih spremenljivk.

- Avtokorelacija in križna korelacija — uporabljeni pri časovnih vrstah za merjenje povezanosti iste spremenljivke (z zamikom) ali med dvema časovnima vrstama.

Interpretacija in statistično testiranje

Poleg vrednosti korelacijskega koeficienta je pomembno poročanje o:

- velikosti vzorca (n) — majhni vzorci lahko dajejo nezanesljive ocene;

- statistični značilnosti (p-vrednost) — pri Pearsonovem r se pogosto uporablja t-test z df = n - 2, vendar p-vrednosti niso vse, kar šteje;

- intervalih zaupanja — pri oceni korelacije je priporočljivo navesti 95% interval zaupanja (Fisher-jeva z-transformacija je pogosto uporabljena za izračun CI).

Pomembno: korelacija ni vzročnost. Dva spremenljivka lahko korigirata zaradi tretjega dejavnika (konfounded), naključja ali sezonskih vzorcev. Primer: povezanost med prodajo sladoleda in številom utopitev je posledica skupnega dejavnika — temperature (poletje).

Predpostavke, pasti in kako se jim izogniti

- Outlierji lahko močno vplivajo na Pearsonov r — preverite grafično razporeditev podatkov;

- Ne-linearnost — močna nelinearna zveza lahko daje r blizu 0; v takih primerih uporabite graf ali transformacijo (npr. log), ali neparametrične koeficiente;

- Heteroskedastičnost (spremenljiva varianca) lahko ogrozi interpretacijo in statistično testiranje;

- Omejen razpon vrednosti (range restriction) znižuje opaženo korelacijo;

- Mere napake in nezanesljive meritve slabšajo opazovan r.

Vizualizacija in praktični nasveti

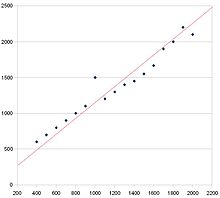

Vedno si oglejte podatke grafično. Na primer:

- na grafu razpršitve (scatterplot) narišite točke in črto najbolje prilegajoče se regresije, da vidite smer in morebitne odstopajoče točke;

- uporabite matriko korelacij in heatmap za več spremenljivk hkrati;

- poročajte korelacijo skupaj z n, p-vrednostjo in intervalom zaupanja;

- če obstaja sum na zamisljen vzrok, razmislite o načinu zbiranja podatkov (eksperimentalni dizajn, kontrola spremenljivk) ali o metodah za oceno vzročnosti (npr. regresija s kontrolami, instrumentalne spremenljivke).

Kratek primer

Če merimo višino in težo skupine ljudi, bomo običajno dobili pozitivno korelacijo (višji ljudje imajo pogosto večjo težo). Pearsonov r bi lahko bil npr. približno 0.6 — to pomeni zmerno do močno pozitivno linearno zvezo. Kljub temu ta korelacija ne pomeni, da višina povzroča težo ali obratno — gre za opis statistične zveze.

Za pravilno uporabo korelacij: preverite predpostavke, poročajte dodatne informacije (n, p, CI), in vedno prikažite podatke grafično — to prepreči napačne zaključke in razkrije skrite vzorce.