Biologijo učenja z nagrajevanjem lahko najdete na spletnih straneh Operantno pogojevanje in Nagrajevanje.

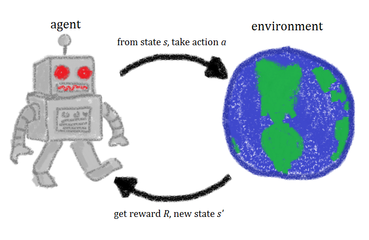

Učenje z ojačitvami (Reinforcement learning - RL) je učenje programskega agenta, kako naj se obnaša v okolju, tako da mu sporočate, kako dobro se obnaša. To je področje strojnega učenja, ki se zgleduje po behavioristični psihologiji.

Učenje z okrepitvijo se razlikuje od nadzorovanega učenja, saj nikoli ne prikažemo pravilnih vhodov in izhodov. Poleg tega se okrepljeno učenje v nasprotju z nadzorovanim učenjem običajno uči sproti (spletno učenje). To pomeni, da mora agent izbirati med raziskovanjem in vztrajanjem pri tem, kar najbolje pozna.

Osnovni pojmi in sestavine

- Agent: entiteta, ki sprejema odločitve (ukrepe).

- Okolje (environment): vse, s čimer agent interagira; vrača opazovanja in nagrade.

- Stanje (state): opis položaja agenta v okolju (lahko delno ali popolno opazno).

- Akcija (action): ukrep, ki ga izbere agent.

- Nagrada (reward): signal, ki ocenjuje dobroto posameznega dejanja glede na cilj.

- Politika (policy): funkcija ali pravilo, ki preslika stanja v verjetnosti ukrepov. Označimo jo π.

- Funkcija vrednosti (value): pričakovana vsota prihodnjih nagrad — pomaga oceniti, katera stanja ali akcije so koristne.

- Model: (če obstaja) napoveduje naslednje stanje ali nagrado; ločimo model-bazirano in model-brez učenje.

Ključne težave in izzivi

- Raziskovanje proti izkoriščanju (exploration vs exploitation): agent mora uravnotežiti poskuse novih dejanj z izkoriščanjem že znanih dobrih strategij (npr. ε-greedy, softmax, UCB).

- Kreditna razdelitev (credit assignment): kako pripisati zasluge za končno nagrado posameznim prejšnjim dejanjem, zlasti pri zamujenih nagradah.

- Delno opazna okolja: agent morda ne vidi celotnega stanja (POMDP), zato mora upoštevati zgodovino ali graditi notranje reprezentacije.

- Učinkovitost vzorčenja: koliko interakcij z okoljem je potrebnih; RL je pogosto neučinkovit glede števila vzorcev.

- Stabilnost in konvergenca: uporaba funkcijskih aproksimatorjev (npr. nevronskih mrež) lahko povzroči nestabilnosti brez ključnih tehnik (replay buffer, target network).

Glavne metode in algoritmi

- Model-free:

- Vrednostno temeljeni: Q-learning, SARSA (uči Q(s,a)).

- Politika-temeljeni: REINFORCE (policy gradients) — neposredno optimizira politiko.

- Actor-Critic: kombinacija politika (actor) in funkcije vrednosti (critic) — primeri: A2C, A3C.

- Model-based: agent uči model okolja in ga uporablja za načrtovanje (npr. Dyna, monte-carlo tree search v AlphaGo).

- Deep RL: uporaba globokih nevronskih mrež za aproksimacijo politik ali vrednosti — primeri: DQN (Deep Q-Network), PPO (Proximal Policy Optimization), SAC (Soft Actor-Critic).

Praktični primeri in uporabe

- Klasični primer: Gridworld — agent se premika po mreži, išče cilj in prejme nagrade/strahovanja.

- Igre: učenje igranja video iger (Atari, Go — AlphaGo), kjer so RL algoritmi dosegli človeško ali nadčloveško raven.

- Robotika: nadzor gibanja, hoja, manipulacija z objekti.

- Industrija in optimizacija: upravljanje skladišč, načrtovanje poti, dinamično določanje cen.

- Sistemi priporočanja in oglaševanja: RL za prilagajanje vsebine v realnem času z upoštevanjem dolgoročnih ciljev.

Priporočene tehnike in dobre prakse

- Reward shaping: previdno oblikovanje nagrad, da agentu olajšamo učenje, vendar pazimo na uvajanje nezaželenih motivacij.

- Uporaba replay buffer in target network za stabilnost učenja v deep RL (npr. DQN).

- Normalizacija vhodov in nagrad, regularizacija in nadzor hitrega pozabljanja (catastrophic forgetting).

- Hiperparametri in evalvacija: merjenje uspešnosti preko več semenskov (seeds), več epizod in ustreznih metrik (povprečna nagrada, robustnost).

Omejitve in etični premisleki

- RL agenti lahko odkrijejo nepričakovane ali varnostno tvegane strategije, če nagradna funkcija ne zajema vseh omejitev.

- Visoka poraba podatkov in stroški simulacij v resničnem svetu (robotika) zahtevajo varnostne ukrepe in simulacijske modele.

- Pri aplikacijah, ki vplivajo na ljudi, je potrebno upoštevati etiko, pristranskost in transparentnost odločitev agenta.

Kratek primer poteka učenja (po korakih)

- Agent opazuje trenutno stanje s.

- Agent izbere akcijo a po politiki π(a|s) (lahko z raziskovanjem).

- Okolje vrne novo stanje s' in nagrado r.

- Agent posodobi svojo politiko ali funkcijo vrednosti glede na (s, a, r, s').

- Ponavlja se, dokler agent ne doseže zadostne zmogljivosti ali konvergenče.

Zaključek

Učenje z ojačitvami povezuje teorijo odločanja, optimizacije in statistike s praktičnimi aplikacijami v igrah, robotiki in industriji. Kljub velikim uspehom v simulacijah in igrah ostajajo izzivi v varnosti, učinkovitosti vzorčenja in prenosu znanja v resnične situacije. Če začnete z RL, je koristno najprej preizkusiti osnovne algoritme na enostavnih simulacijah (Gridworld, OpenAI Gym) in postopoma preiti na kompleksnejše modele ter tehnike globokega učenja.